OpenAI: Ex empleados crean constitución para una IA segura

Sin duda, en toda empresa hay empleados que no están de acuerdo con ciertas tomas de decisiones y esto no ha sido una excepción con OpenAI.

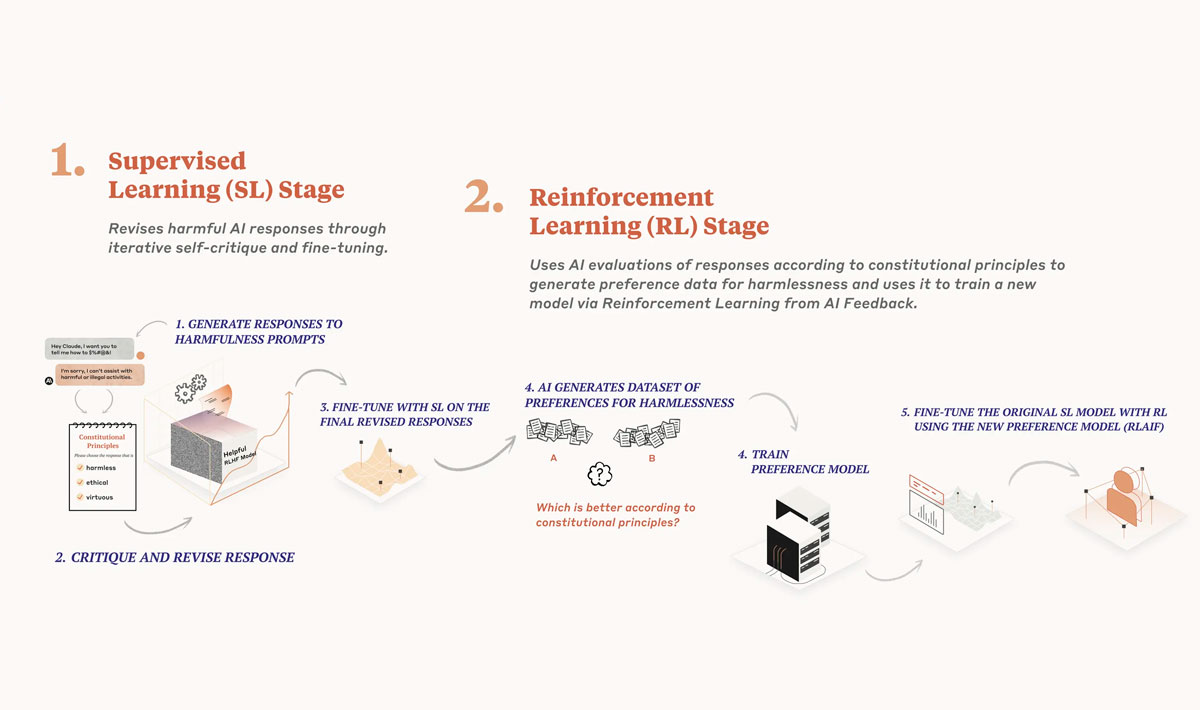

Ex empleados de OpenAI fundaron su propia start-up llamada Anthropic con su propio chatbot IA Claude. Sin embargo, a diferencia de ChatGPT este tiene una serie de valores morales con su propia «constitución». Por este motivo, Claude ha sido bautizado como «IA Constitucional». Puesto que se basa en varias fuentes públicas como la Declaración Universal de los Derechos Humanos de las Naciones Unidas. De esta manera, Claude debe elegir la mejor respuesta que se opongo a la tortura, crueldad, esclavitud y trato inhumano o degradante. Asimismo, que se elija una respuesta que tenga menos información personal, privada o confidencial de otros.

Como se sabe, hace tan solo unos días, el presidente de los Estados Unidos, Joe Biden, se reunió con los desarrolladores más importantes de IA como Open AI, Google, Microsoft y ahora Anthropic en la Casa Blanca. La reunión era para garantizar la seguridad y ética de estas inteligencias artificiales. Debido a esto, la start-up quiere seguir explorando nuevas formas de democratizar la constitución para Claude y así tener constituciones personalizables para ciertos casos.

Fuente: Anthropic